Assistance aux personnes du robot autonome au robot social

Au LAAS-CNRS, Rachid Alami et son équipe Robotique et Interactions mènent des recherches pour développer des robots qui pourraient un jour être mis au service des personnes âgées et/ou dépendantes.

Propos recueillis par Camille Pons, journaliste scientifique.

En quoi vos recherches pourraient-elles servir aux personnes âgées ?

Rachid Alami : Une étude a montré que les trois demandes dominantes sont « amène-moi la télécommande, mes lunettes, mes médicaments », mais on peut aussi imaginer un robot qui aide à se déplacer, détecte les inactivités ou les chutes. Le cœur de notre travail est de tendre vers un robot qui ne soit pas seulement autonome mais aussi en interaction avec les êtres humains. Un robot et une personne sont deux usagers d’un même lieu. Mais pour le robot, des manières de faire sont préférables à d’autres afin que l’être humain ne soit pas dérangé. Nous travaillons donc sur les fonctions dites de robot social.

au Laboratoire d'Analyse et d'Architecture

des Systèmes (LAAS-CNRS)

Quelles sont ces compétences sociales ?

RA : Nous cherchons d’abord à intégrer des notions de proxémie (distance physique acceptable entre des personnes prises dans une interaction) sur lesquelles le psychologue Edward Hall a travaillé. Celui-ci a défini quatre sphères : publique, sociale, personnelle et intime. Il est estimé que les distances à respecter dans ces espaces varient de 15 centimètres à 3,6 mètres, pour que l’interaction soit acceptée. Ce qui signifie qu’on ne doit pas choisir nécessairement la trajectoire optimale si celle-ci dérange ou surprend. Par exemple, un robot équipé de capteurs et caméras sur 360 degrés n’a en théorie pas besoin de se retourner pour amener un objet. Il peut reculer pour le saisir, ce qui est plus efficace. Mais il doit quand même se retourner, car c’est plus compréhensible par la personne. Nous voulons aussi qu’un robot soit capable de se mettre à sa place pour évaluer ce dont elle a besoin.

Comment travaillez-vous pour développer ces compétences ?

RA : Pour développer les algorithmes puis les logiciels, nous devons d’abord étudier les signaux que se font les humains. Ce qui implique un travail interdisciplinaire, avec des psychologues, des philosophes, des ergonomes... Aucune discipline ne peut régler seule le problème de l’assistance à la personne. Nous avons, en 2015, avec le laboratoire Cognition, langues, langage, ergonomie (CLLE), analysé les signaux qu’une personne émet par son regard, sa vitesse, etc. lorsqu’elle tend un objet à une autre personne, afin que celle-ci puisse prédire ce qui va être fait et mettre la main là où l’objet va être déposé. Différents scénarios ont été filmés puis montrés à des panels. Deux préférences sont apparues : regarder l’objet puis l’humain, regarder l’humain puis l’objet puis à nouveau l’humain. Et nous venons d’achever un projet européen qui portait sur un robot-guide d’aéroport, Spencer, qui nous a permis de tester différentes fonctionnalités avec des passagers, afin de le rendre prévisible et acceptable.

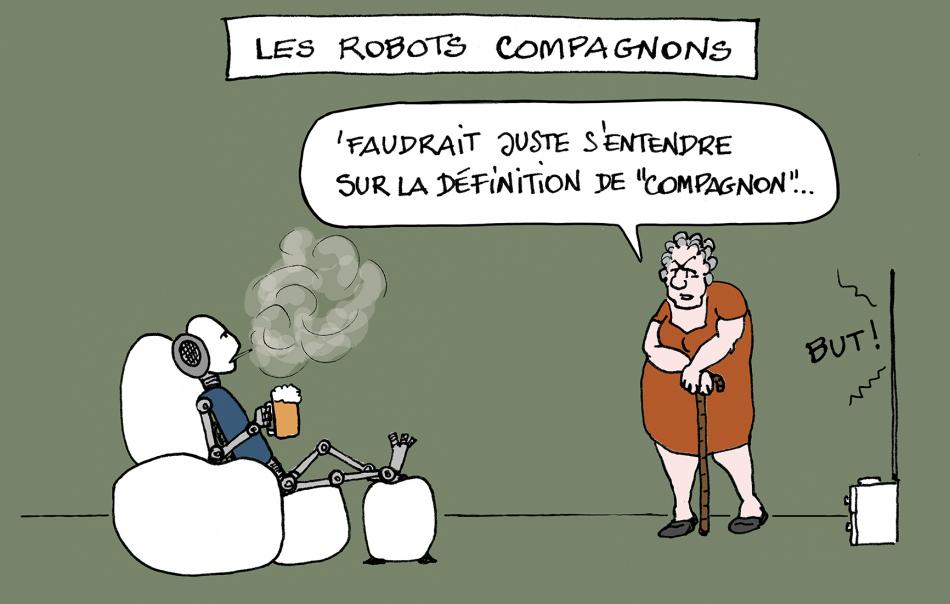

Les robots que l’on propose actuellement aux personnes âgées vous semblent-ils jouer un rôle d’assistance ?

RA : Ils ont des fonctions peu poussées. Ils ne peuvent réaliser que de petites tâches comme donner un objet, faire boire ou assurer une téléprésence ... Le robot véritablement à disposition des personnes âgées n’a pas encore été développé. Mais nous pensons que c’est possible. Il existe d’ailleurs beaucoup de projets, européens notamment, et des utilisations très particulières, thérapeutiques, dans le cadre de protocoles expérimentaux. Et si nous y arrivons, encore faudra-t-il en établir l’acceptabilité individuelle et l’acceptabilité sociale. Sera-t-on capable de laisser sa grand-mère avec un robot sans lien affectif ?

CLLE : Cognition, langues, langage, ergonomie (CNRS, Université Toulouse – Jean Jaurès, EPHE, Université Michel de Montaigne Bordeaux 3)